十二小时惊魂 凌晨数据迁移事故与我的技术救赎

凌晨两点三十分,整座城市陷入沉睡。我坐在服务器机房的冷光中,屏幕的蓝光映在脸上——这是计划已久的生产数据库迁移时刻。作为项目的主程,我反复检查过脚本、备份和回滚方案,自认万无一失。按下回车键的那一刻,心跳声在寂静中格外清晰。

最初三十分钟,数据同步进度条平稳推进。我起身冲了杯浓咖啡,等待这例行公事的结束。然而四十五分钟时,监控面板突然弹出第一个警告:从库同步延迟超过阈值。我皱皱眉,这在意料之中——大数据量迁移常有短暂延迟。

真正的噩梦始于凌晨三点十七分。主库连接数飙升至极限,CPU占用率瞬间突破95%。‘不可能’,我喃喃自语,迁移脚本应该只涉及读取操作。当第一个线上服务报错出现在告警群时,手指开始发凉。五分钟内,客服系统、支付接口、用户中心相继失联——我们最核心的三个服务全部瘫痪。

冷汗浸透了衬衫。我强迫自己深呼吸,第一件事不是排查问题,而是启动应急预案:

- 立即在运维群发布红色警报

- 通知所有相关技术负责人紧急上线

- 向运营团队通报预计恢复时间(我颤抖着写下‘2小时’,心里完全没底)

回滚!这是唯一念头。但当执行预演过数十次的回滚脚本时,终端返回了致命错误:‘备份文件校验失败’。原来,为了节省存储空间,有人(后来证实是三个月前的我)修改了备份策略,每日全量备份被改为增量备份,而迁移前的完整验证流程被跳过了。

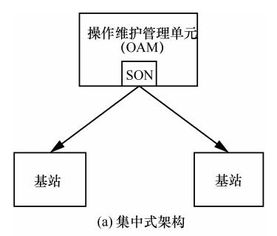

凌晨四点,会议室挤满了睡眼惺忪但神情严峻的同事。CTO的声音通过免提传来:‘我们需要时间线,现在就要。’我在白板上画出的故障图谱让所有人倒吸凉气——由于一个隐晦的触发器递归调用,迁移过程意外激活了本应禁用的数据清洗流程,这个流程又连锁触发了多个微服务间的循环依赖。

技术总监盯着监控图突然问:‘为什么网络流量在服务瘫痪后反而增加了?’这个发现成为转折点。我们追踪到异常流量来自某个边缘节点的健康检查机制——它在检测到主服务不可用时,正以每秒数百次的频率疯狂重试,这些请求堆积在负载均衡层,形成了雪崩效应。

解决方案需要同时做四件事:

- 紧急下线故障触发器(需要直接操作数据库)

- 在防火墙层面阻断异常流量

- 重启关键服务(必须按特定顺序,否则会引发更复杂的死锁)

- 准备数据修复脚本(部分表已出现不一致)

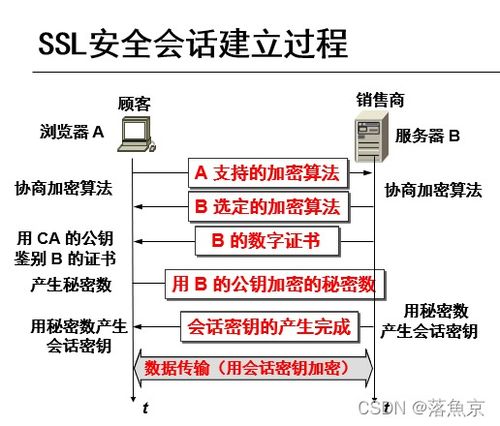

凌晨五点三十分,当太阳即将升起时,我们找到了最危险的‘定时炸弹’:由于事务隔离级别设置问题,部分财务数据处于‘半迁移’状态,如果按现有方案恢复,将导致数百万元资金对账错误。后端架构师提出了一个大胆方案——利用binlog和redo log的时间差,重构出故障前最后一秒的完整数据视图。

接下来是如履薄冰的操作。每执行一条命令,都需要两人交叉确认。我的手心全是汗,不是因为技术难度,而是因为知道每一次回车都可能让公司蒙受七位数的损失。早上七点,当第一个核心服务恢复正常时,会议室里没有欢呼,只有更紧张的沉默——我们还需要验证数据的绝对一致性。

上午九点,最后一个数据校验通过。连续十二个小时的高压后,我瘫在椅子上,看着监控面板上重新泛起的绿色波浪。事后复盘会上,我们梳理出十七个流程漏洞,其中九个是‘从未想过会出问题的环节’。

这次惊魂记教会我的,远超出技术范畴:

- 最危险的往往不是复杂的技术方案,而是那些‘简单到不需要测试’的基础环节

- 应急预案必须包含‘预案失效’的应对策略

- 系统复杂性增长时,故障的传播路径会以指数级变得难以预测

- 团队在危机中的沟通效率决定了止损的天花板

如今,机房墙上的白板还保留着那天凌晨画的故障传播图。它提醒每个经过的人:在数字世界的宁静表面下,永远潜伏着意想不到的连锁反应。而我们这些搭建者,既要怀有让系统完美的雄心,也要时刻保持对复杂性的敬畏——因为下一次回车键按下时,可能是另一个平静的凌晨,也可能是另一场需要十二小时才能醒来的技术噩梦。

如若转载,请注明出处:http://www.dapu100.com/product/83.html

更新时间:2026-06-03 12:00:09